Die Europäische Union hat als erste Ländergemeinschaft der Welt ein Gesetz zur Regelung der künstlichen Intelligenz verabschiedet. Aber warum ist dies notwendig? In einer Zeit der rasanten technologischen Entwicklung kann künstliche Intelligenz zu manipulativen oder potenziell schädlichen Zwecken eingesetzt werden. Um dies zu verhindern und der Öffentlichkeit verlässlichen Schutz und Sicherheit zu bieten, hat die EU beschlossen, einen systematischen Rechtsrahmen – den EU AI Act – einzuführen, der Risiken klassifiziert, ethische Grenzen setzt und einen Rahmen für eine verantwortungsvolle Technologieentwicklung schafft.

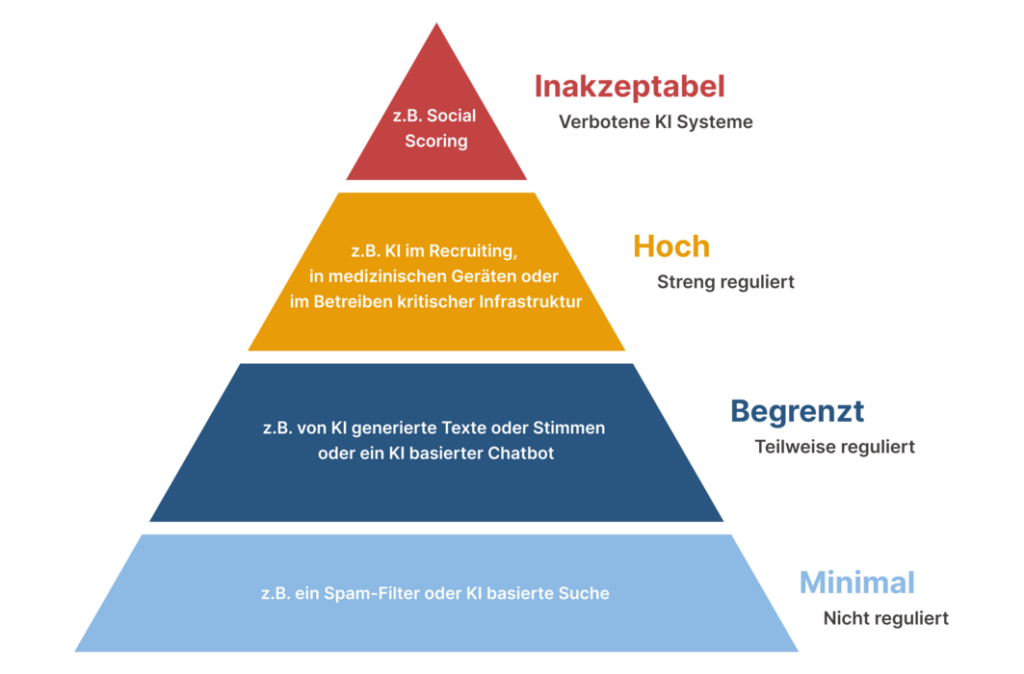

Die Grafik zeigt, wie das KI-Gesetz KI-Systeme in verschiedene Risikostufen einstuft:

Inakzeptables Risiko: Systeme, deren Einsatz verboten ist. Dazu gehört der Einsatz von KI für Social Scoring, bestimmte Arten der biometrischen Überwachung, automatische Emotionserkennung und verdeckte Verhaltensbeeinflussung. Bestimmte Ausnahmen sind für Strafverfolgungsbehörden, Militär und Nachrichtendienste vorgesehen.

Hohes Risiko: Systeme, an die strenge Anforderungen gestellt werden. Dazu gehören beispielsweise Systeme, die biometrische Daten verarbeiten oder in den Bereichen kritische Infrastrukturen, Bildung, Beschäftigung, Kreditwürdigkeitsprüfung, Versicherungen, Vorhersage der Wiederholung von Straftaten und einige andere.

Systeme mit Transparenzanforderungen: Erfordern eine besondere Kennzeichnung. Dies ist der Fall bei Inhalten, die vollständig von generativer KI erstellt wurden, wie Fotos, Videos oder sogar Texte, wenn sie nicht von Menschen bearbeitet wurden. Solche Inhalte sollten eindeutig gekennzeichnet werden, einschließlich maschinenlesbarer Etiketten, um die Nutzer:innen über ihre Interaktion mit der KI zu informieren.

Geringes oder kein Risiko: Erfordert keine zusätzlichen Vorschriften. Beispiele hierfür sind Filter für soziale Medien oder ähnliche Unterhaltungs- und Hilfstechnologien.

Wer ist verpflichtet, das KI-Gesetz einzuhalten?

Anbieter von Hochrisikosystemen – sowohl aus der EU als auch aus Drittländern –, wenn das System in der EU eingesetzt wird.

Die Nutzer:innen von KI-Systemen im Rahmen ihrer beruflichen Tätigkeit unterliegen ebenfalls der Regulierung, wenn auch mit geringerer Verantwortung als die Entwickler:innen.

Was sollten Anbieter von Hochrisikosystemen tun?

Im Allgemeinen müssen alle Hochrisikosysteme sowie GPI-Modelle:

- eine technische Dokumentation erstellen,

- eine Dokumentation für diejenigen bereitstellen, die das Modell in Zukunft nutzen werden,

- das Urheberrecht einhalten,

- eine Beschreibung der Daten veröffentlichen, auf denen das Modell trainiert wurde.

Was sind GPAI-Modelle?

Sogenannte GPAI-Modelle sind KI-Modelle, die in der Lage sind, ein breites Spektrum unterschiedlicher Aufgaben zu erfüllen und sich in verschiedene Systeme oder Anwendungen zu integrieren. Sie können mit Hilfe von Selbstlernverfahren auf eine große Datenmenge trainiert werden und sind sehr vielseitig einsetzbar. Modelle, die noch nicht auf dem Markt sind und nur zu Forschungs- oder Testzwecken verwendet werden, sind hier nicht eingeschlossen.

Dennoch gibt es GPAI-Modelle, die quelloffen sind, was bedeutet, dass alle Parameter, die Struktur, die Gewichte und die Art und Weise, wie sie verwendet werden, der Öffentlichkeit zur Verfügung stehen, so dass der Entwickler nur zwei Hauptanforderungen erfüllen muss:

- Respekt für das Urheberrecht,

- Veröffentlichung einer Beschreibung der Trainingsdaten.

Aber auch wenn ein offenes Modell als „systemisch“ gilt, unterliegt es zusätzlichen Anforderungen.

Systemische Modelle sind solche, die mit enormen Rechenressourcen trainiert werden – mehr als 10²⁵ FLOPs – und als potenziell gefährlich oder mit systemischen Auswirkungen betrachtet werden. Bei der Erstellung solcher Modelle muss der Entwickler die Europäische Kommission innerhalb von zwei Wochen informieren und erklären, warum sein Modell trotz seiner hohen Rechenleistung nicht gefährlich ist. Die Kommission kann dann entweder von sich aus oder auf der Grundlage der Ergebnisse eines wissenschaftlichen Gremiums entscheiden, ob das Modell systemrelevante Auswirkungen hat. Falls ja, werden zusätzliche Verpflichtungen festgelegt:

- Bewertung des Modells – Durchführung spezieller Tests zur Ermittlung von Schwachstellen, zum Beispiel Manipulationsanfälligkeit.

- Identifizierung und Abschwächung von Risiken, die das Modell darstellen kann.

- Nachverfolgung schwerwiegender Vorfälle – sie müssen aufgezeichnet und den Aufsichtsbehörden gemeldet werden.

- Sicherstellung eines hohen Niveaus an Cybersicherheit.

Was bedeutet das für KMU?

Auf der offiziellen Website des EU Artificial Intelligence Act gibt es einen eigenen Abschnitt, der kleinen und mittleren Unternehmen gewidmet ist. Dort heißt es, dass kleine Unternehmen vorrangig Zugang zu „regulatorischen Sandkästen“ erhalten – spezielle Räume, in denen KMU ihre KI-Systeme unter realen Bedingungen testen können, ohne Angst haben zu müssen, gegen das Gesetz zu verstoßen.

Darüber hinaus sind die EU-Mitgliedsstaaten laut EU-Recht verpflichtet, den Verwaltungsaufwand für KMU zu minimieren, ihnen die Einreichung von Dokumenten in mehreren Sprachen zu ermöglichen, die Konformitätsbewertung zugänglich und kostengünstig zu gestalten und unnötige Hindernisse im Registrierungsverfahren zu vermeiden. Gleichzeitig sollte die Höhe der Strafen, die auf die Unternehmen zukommen können, auch nach dem Maßstab bestimmt werden. Für kleine und mittlere Unternehmen sollten nicht die gleichen Höchststrafen gelten wie für große Unternehmen, und die Höhe der Haftung sollte verhältnismäßig sein.

Die Europäische Kommission will auch helfen, indem sie Folgendes schafft:

- Dokumentationsvorlagen, die auf kleine Unternehmen zugeschnitten sind,

- Schulungsmaterial,

- Informationskampagnen zur Erläuterung des Gesetzes,

- Kommunikationskanäle, über die sich KMUs beraten lassen können.

Schließlich trat das KI-Gesetz am 1. August 2024 in Kraft, und seine Bestimmungen werden ab dem 2. August 2026 angewandt, mit einigen Ausnahmen, für die andere Fristen vorgesehen sind.